鑫捷科技(Webplus)專精於AI整合、資訊安全、系統與網路建置、虛擬化、大數據分析及軟體開發,提供一站式企業IT解決方案,服務涵蓋從網路連線到端點安全,涵括雲端資訊整合、資料備份、系統備援規劃等,協助臺灣及海外政府機關與中大型企業客戶規劃與整合資訊系統,共創資訊科技新未來。

AI資料外洩風險解析:企業導入生成式AI的控管重點

【AI資安專題(2/3)】

本文延續前篇AI社交工程攻擊的分析,進一步聚焦企業在導入生成式AI時最常被忽略的風險——AI資料外洩。

👉 前篇閱讀:AI社交工程攻擊升級:企業如何防範釣魚郵件與Deepfake詐騙

AI資料外洩:不是駭客,而是日常操作

當企業開始導入生成式AI工具,資安風險的來源也隨之改變。與傳統外部攻擊不同,AI資料外洩往往發生在日常使用情境中,例如員工在查詢問題、整理文件或撰寫內容時,將內部資料輸入AI系統。

根據 IBM Security 與 Gartner 的研究,企業在導入AI工具初期,最容易忽略的並非系統漏洞,而是資料在使用過程中的暴露風險。因此,AI帶來的挑戰不只是技術問題,更是資料治理與使用習慣的轉變。

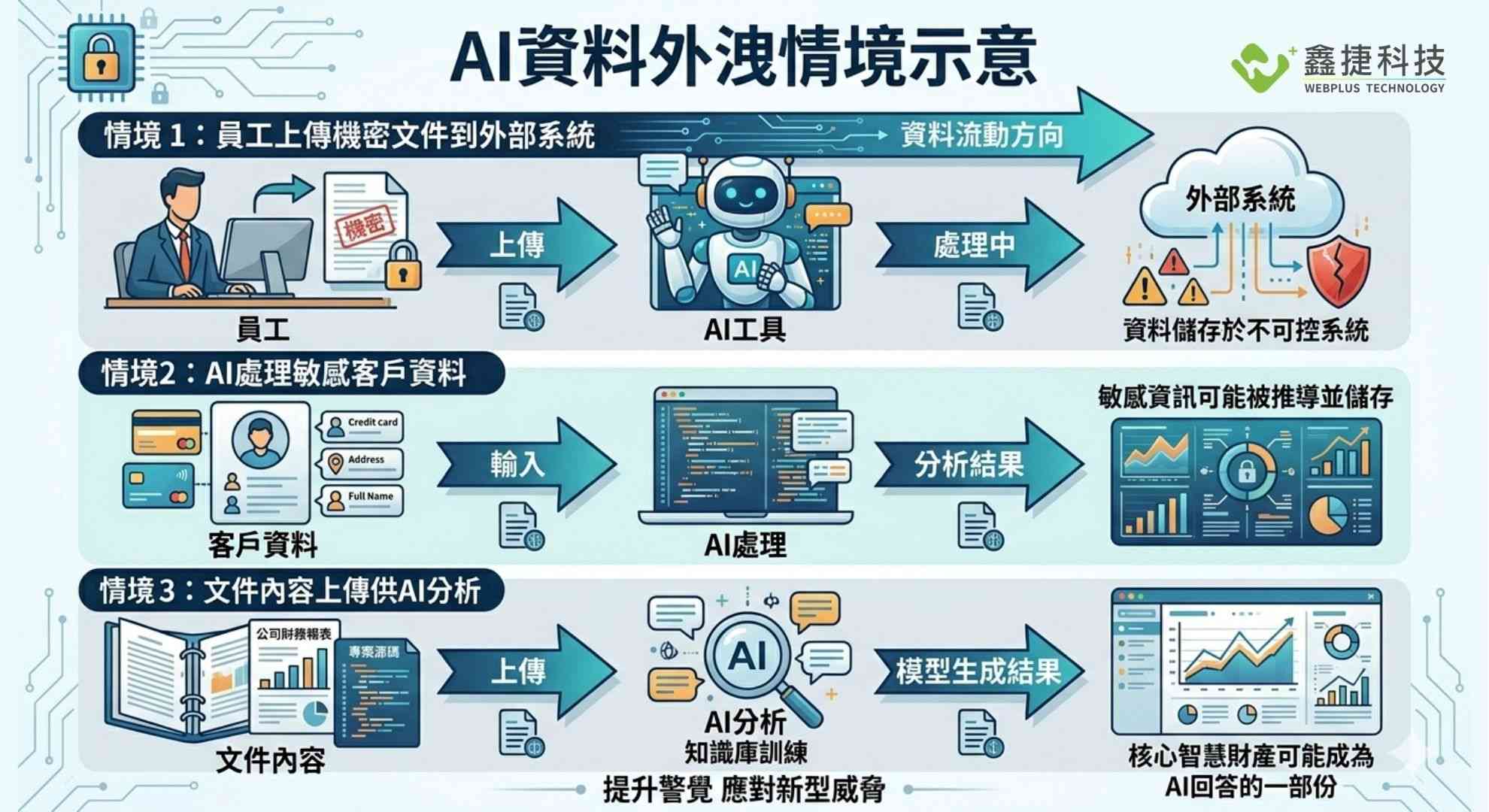

常見情境:AI如何讓資料在不知不覺中外流

AI資料外洩通常不是刻意行為,而是來自便利性帶來的風險。例如:

- 員工將客戶資料貼入AI工具進行分析

- 將內部報表或合約內容輸入生成摘要

- 使用AI協助撰寫程式碼時包含敏感資訊

這些操作看似日常,但若AI服務未明確限制資料使用範圍,輸入內容可能被系統記錄或用於模型訓練,進而增加外洩風險。

同時,當企業缺乏統一管理機制,不同部門各自使用AI工具,也會讓資料流向變得難以追蹤。

為什麼傳統資安機制難以防範

值得注意的是,AI資料外洩往往難以被傳統資安工具偵測。原因在於:

首先,資料是由「合法使用者」主動輸入,並非異常入侵行為;其次,資料傳輸通常發生在正常應用流程中,不易被判定為威脅。換句話說,這類風險並不是「攻擊」,而是「使用行為」。

因此,單靠防火牆或端點防護,無法有效解決問題。

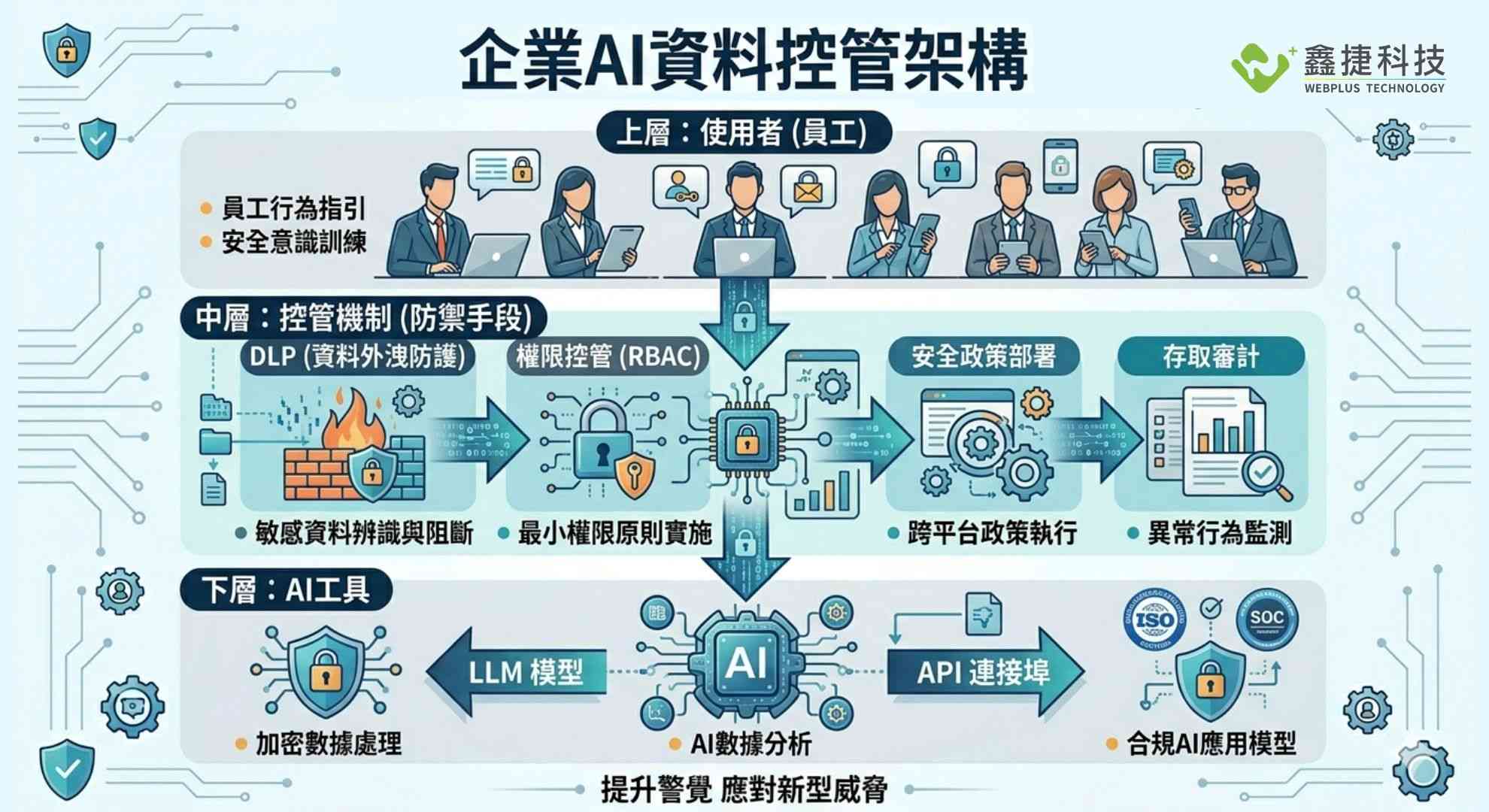

企業如何降低AI資料外洩風險

面對這類新型風險,企業需要從「控管」而非「阻擋」的角度思考:

- 資料分類與權限控管:明確定義哪些資料不得輸入AI工具

- 導入DLP(資料外洩防護)機制:監控敏感資訊的流動

- 建立AI使用規範:規範員工使用情境與工具範圍

- 集中管理AI服務:避免各部門自行導入造成風險分散

這些措施的重點,在於讓AI使用「可控且可追蹤」,而非完全禁止。

下一步:建立可長期運作的資安架構

當企業同時面對外部AI攻擊與內部資料風險,單點防護已難以應對。下一步需要的是一套能持續驗證與控管的整體架構。

👉 延伸閱讀:Zero Trust 架構實務:AI時代的企業資安防禦策略(敬請期待)