鑫捷科技(Webplus)專精於AI整合、資訊安全、系統與網路建置、虛擬化、大數據分析及軟體開發,提供一站式企業IT解決方案,服務涵蓋從網路連線到端點安全,涵括雲端資訊整合、資料備份、系統備援規劃等,協助臺灣及海外政府機關與中大型企業客戶規劃與整合資訊系統,共創資訊科技新未來。

AI社交工程攻擊升級:從釣魚郵件到Deepfake詐騙

本文為AI資安系列延伸內容,延續前篇對AI攻擊趨勢的觀察,進一步解析AI社交工程攻擊的實務風險。

👉 前篇閱讀:AI 網路攻擊升級:微軟揭露 21 種威脅手法,企業資安防禦新階段

一封「看起來完全正常」的郵件,可能就是攻擊起點

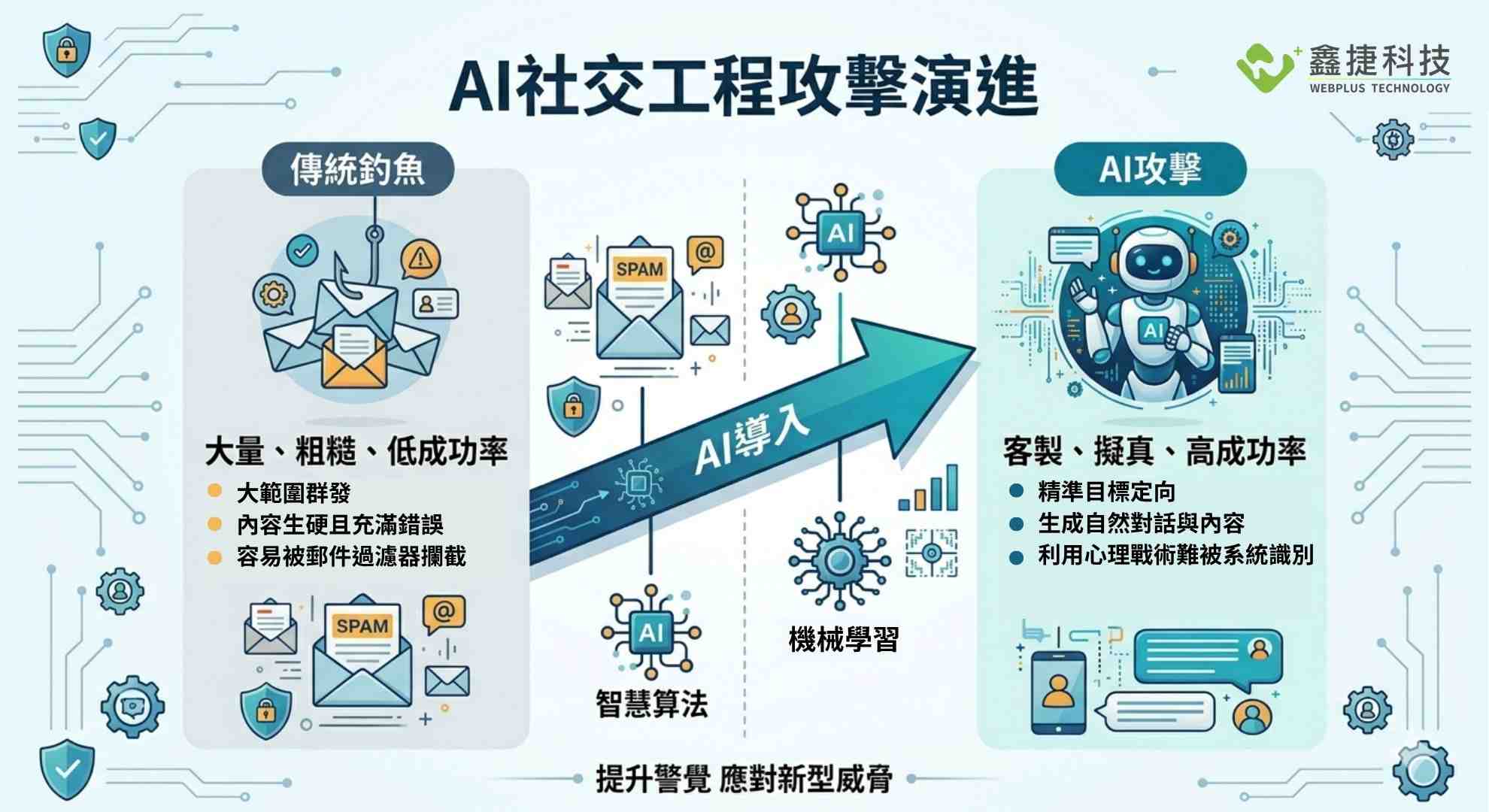

AI社交工程攻擊正快速升級。從釣魚郵件到Deepfake詐騙,攻擊手法已不再依賴傳統漏洞,而是直接利用人性與信任機制。

想像一封來自主管的緊急郵件,語氣自然、內容合理,甚至提到正在進行的專案名稱,要求你協助確認帳號或處理付款。這類訊息在日常工作中並不罕見,但如今它很可能不是人寫的,而是由AI生成的釣魚攻擊。

隨著生成式AI普及,社交工程攻擊已從「大量散發」轉向「精準設計」。根據 Microsoft Security 與 IBM Security 的研究觀察,攻擊者正利用AI快速生成語意自然、情境合理的內容,使郵件更難以辨識。

AI釣魚郵件:從破綻百出到高度擬真

過去釣魚郵件常因語法錯誤或格式異常而被識破,但AI已大幅降低這些破綻。攻擊者可透過公開資訊(如公司網站、社群資料)拼湊背景,並生成符合企業語境的內容。

例如,一封看似來自財務主管的郵件,可能同時具備正確的語氣、專案名稱與時程壓力,讓收件者在忙碌中快速做出回應。這類攻擊不再依賴技術漏洞,而是鎖定「信任機制」本身。

也因此,企業面臨的挑戰已從「阻擋惡意程式」轉變為「辨識高度擬真的溝通內容」。

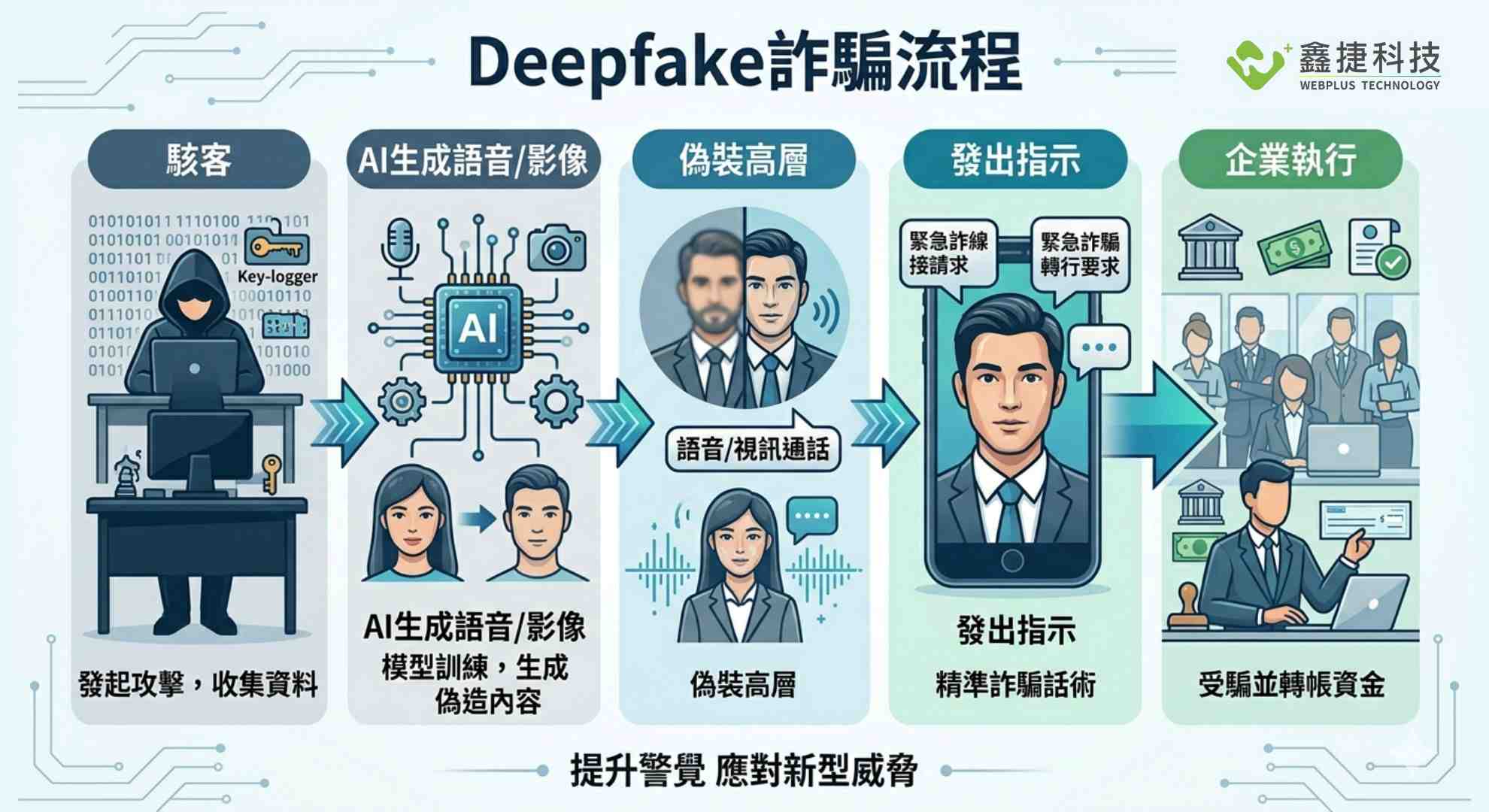

Deepfake詐騙:當聲音與影像也不再可信

除了文字,AI也讓聲音與影像的可信度受到動搖。根據 ENISA 的分析,Deepfake技術已被應用於企業詐騙,例如偽造高層語音指示匯款,或在視訊會議中模擬特定人員進行決策指示。

這類攻擊之所以危險,在於其突破了傳統驗證方式。過去企業可能透過電話或視訊再次確認,但當聲音與影像都可被模擬時,「看見本人」或「聽見聲音」已不再等同於真實身分。

防禦思維轉變:降低錯誤信任,而非完全阻擋

面對AI驅動的社交工程攻擊,單一防護措施難以奏效。關鍵不在於完全阻止攻擊,而是降低「誤信」的機率。

實務上,企業可從三個面向著手,降低AI社交工程攻擊帶來的風險:

- 郵件安全機制:導入具備行為分析能力的防護工具,辨識異常溝通模式

- 多重身分驗證(MFA):避免帳密外洩後被直接利用

- 員工資安意識訓練:提升對AI生成內容的辨識能力

這些措施的核心目標一致:即使攻擊進入環境,也能限制其影響範圍。

下一個風險:來自企業內部的AI使用行為

值得注意的是,企業風險不只來自外部攻擊。當員工開始在日常工作中使用生成式AI工具,若缺乏控管機制,敏感資料可能在不經意間被輸入外部系統,進而產生外洩風險。

這類情境並非理論,而是已逐漸成為企業導入AI時必須面對的實務問題。

👉 延伸閱讀:企業導入AI的最大風險:資料外洩與模型濫用(下一篇,將解析實際風險與控管策略,敬請期待)